在前面的文章中,我写过 DeepSeek 免费 API 的薅羊毛教程,以及 欧派云、火山引擎 DeepSeek 配置教程。当时顺便提及了一款非常好用的大模型客户端 CherryStudio,不过当时只提及它具备一般的 AI 大模型问答功能,其实 Cherry Studio 还可以让我们构建本地知识库(即 RAG)。(关联阅读:如何在 Obsidian 中构建 AI 知识库)

今天就简单写一篇文章,讲讲如何实现。

下载安装 Cherry Studio

这部分的内容不再赘述,你可以阅读这篇文章。

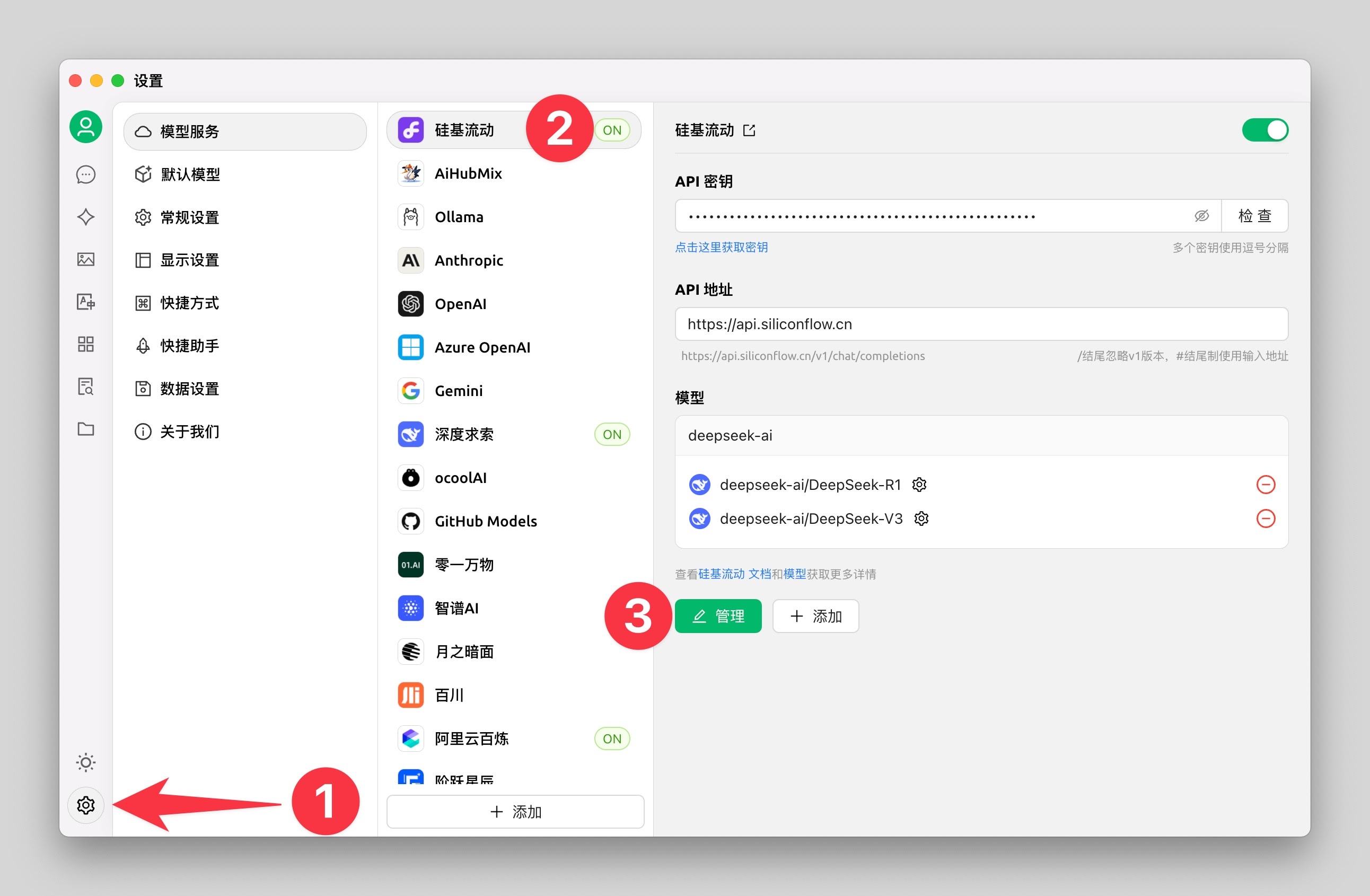

设置嵌入模型

找到硅基流动,点击如图所示的「管理按钮」

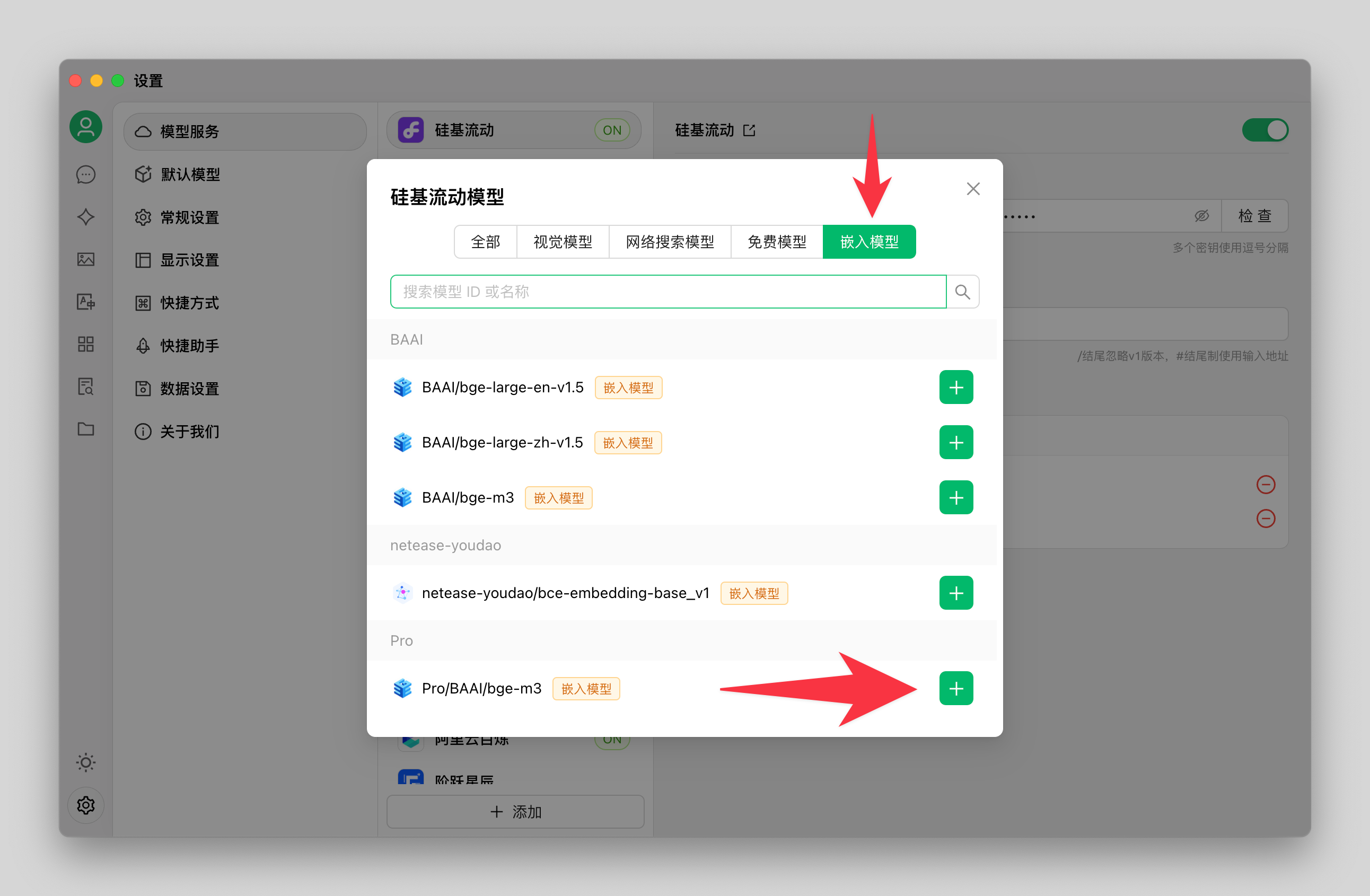

在「嵌入模型」选项中,点击 bge-me 这个模型的加号 ➕

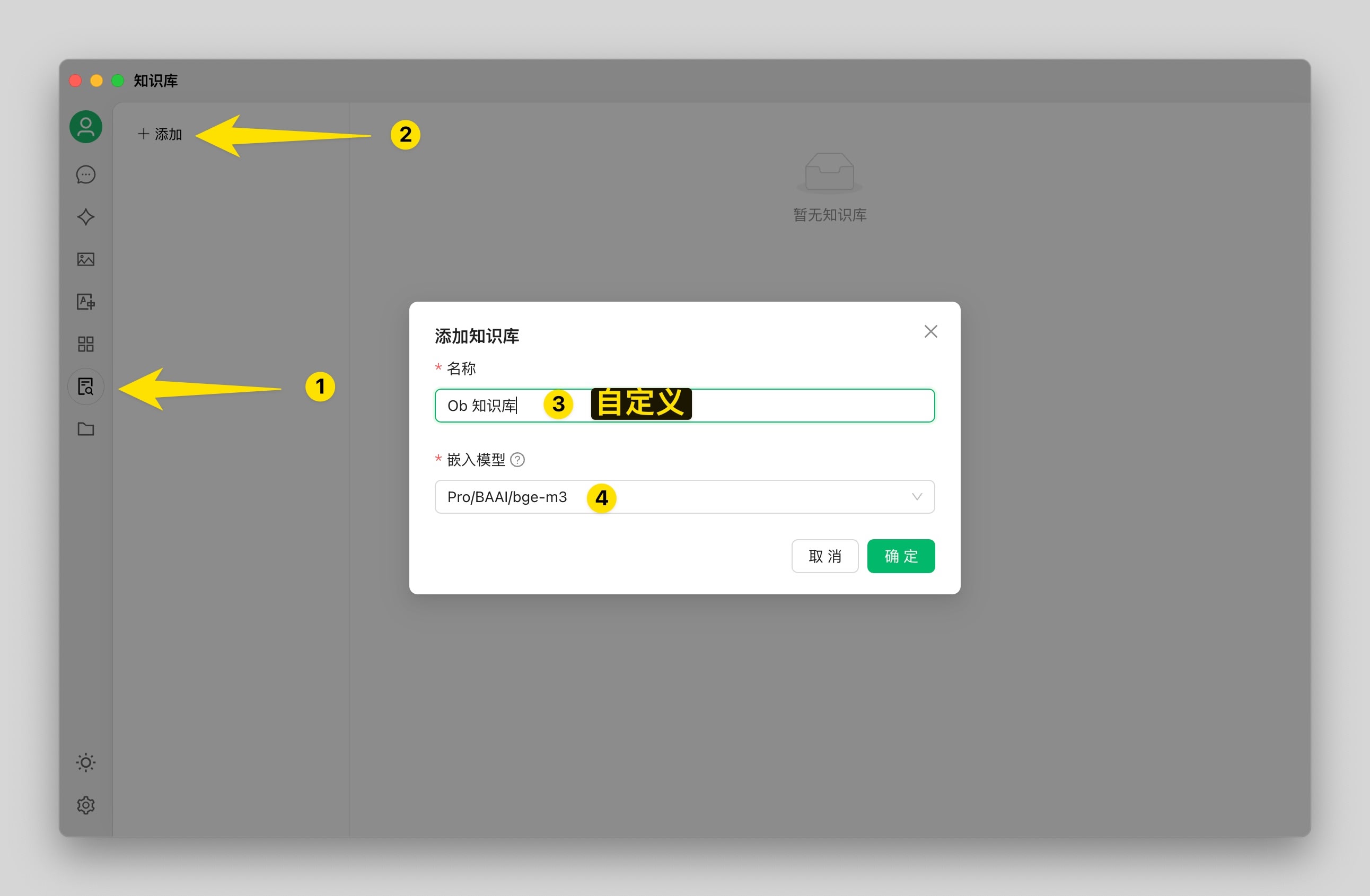

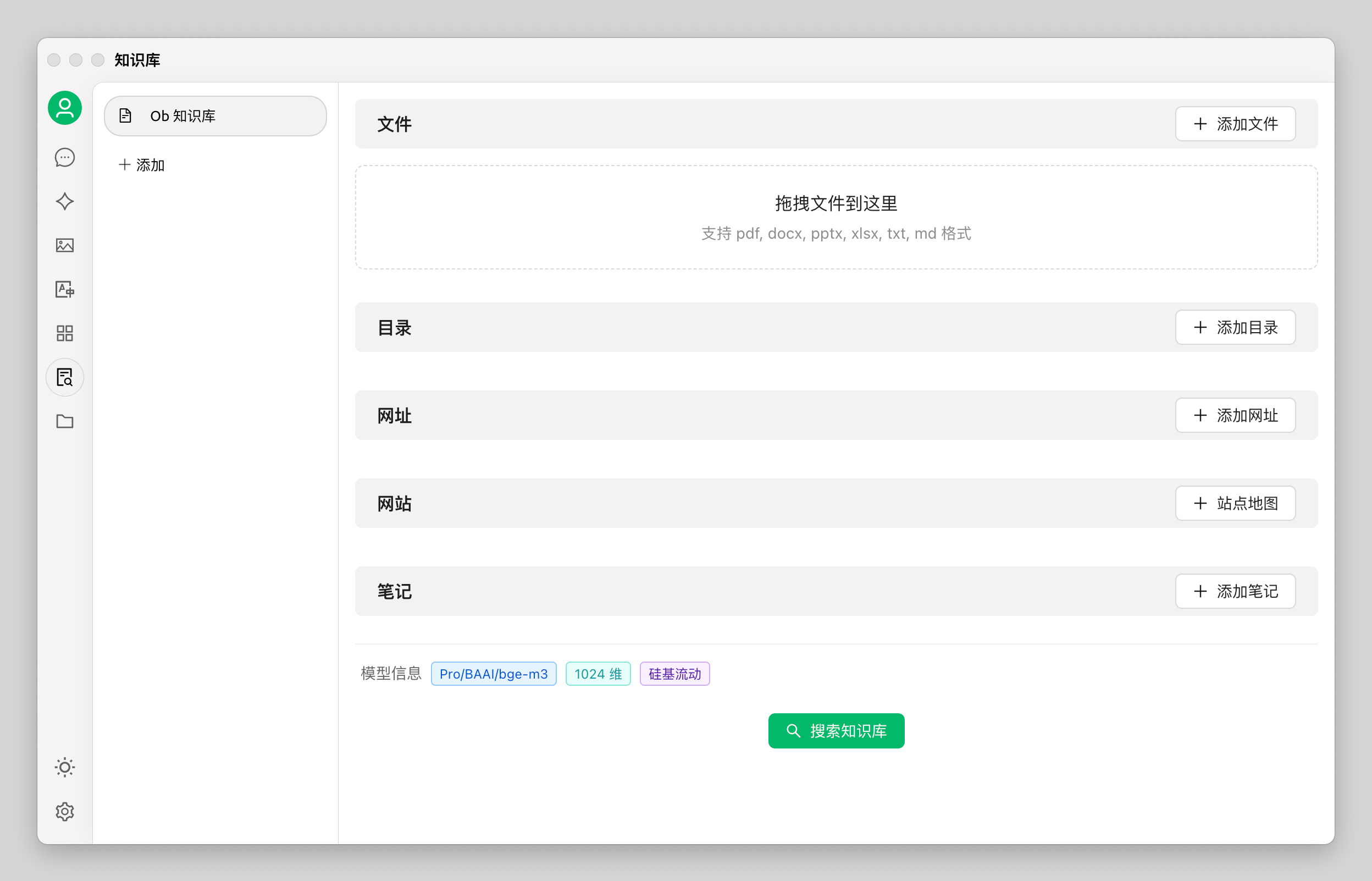

创建知识库

按照如图所示进行设置,然后点击确定

随后你就可以添加任意文件、目录或者网址

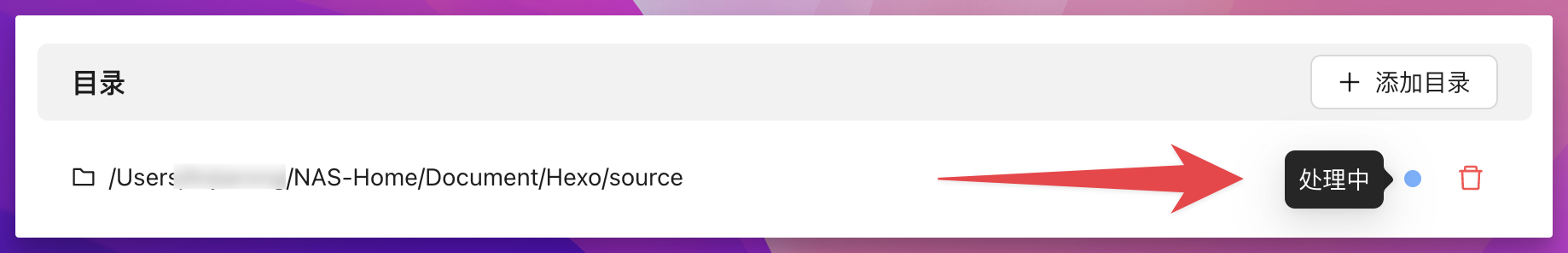

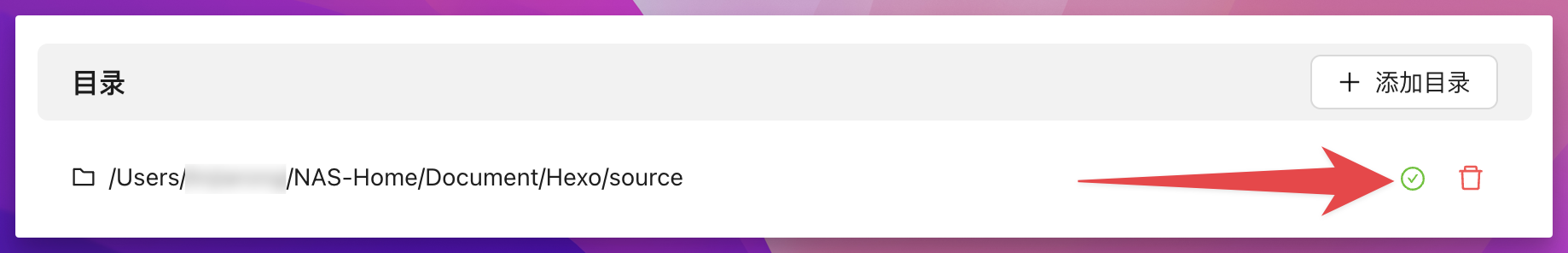

这里我尝试添加一个文档数大约 2000 个,字数超过 150 万字的 Obsidian 文档库目录,它就会开始进行嵌入处理。

不到一分钟的时间,嵌入就处理完毕了,相当快。

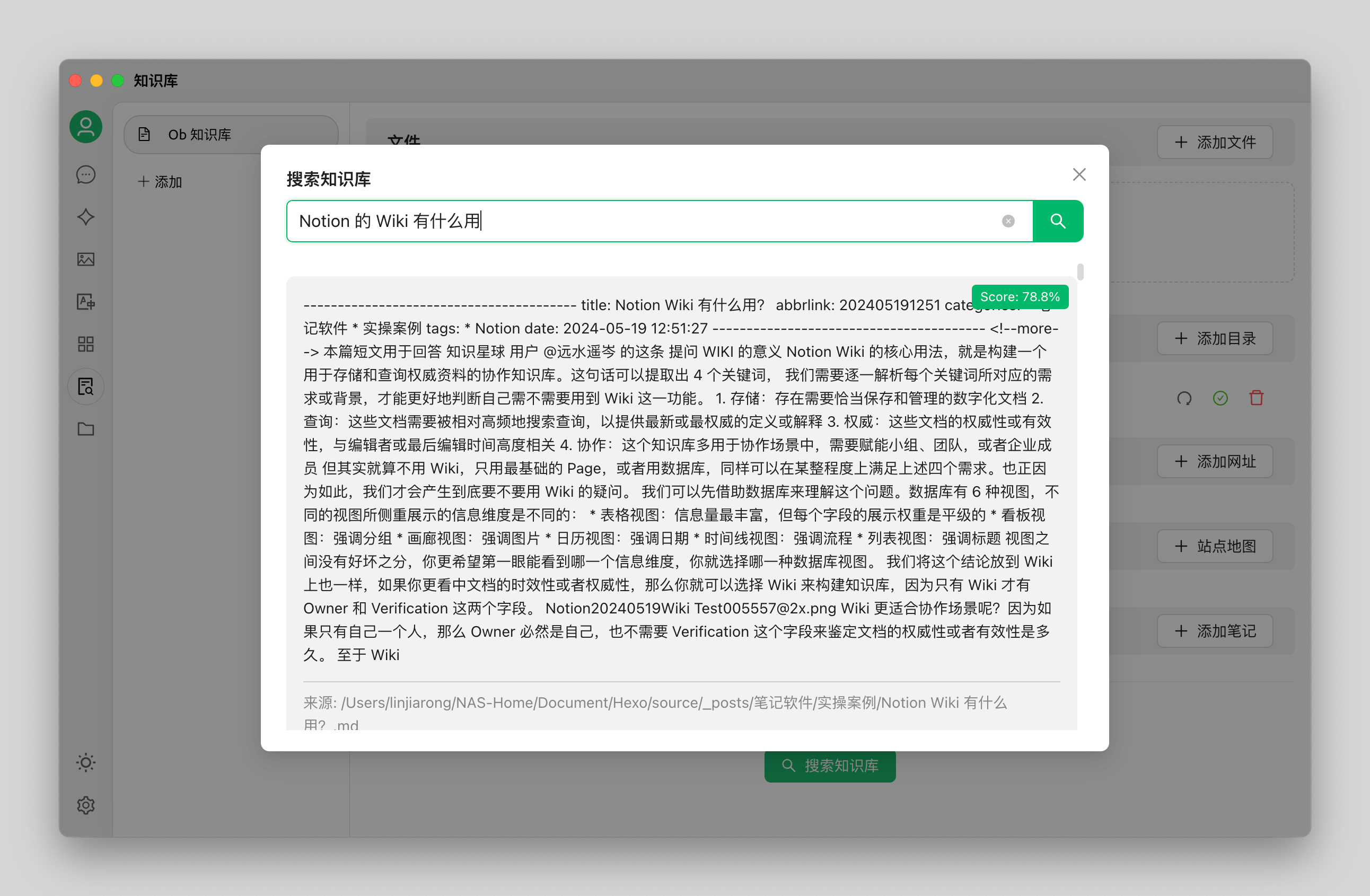

然后就可以对这个知识库进行搜索了,Cherry Studio 会查找与你问题相关的文档,然后按照相关性进行排序。

在 Cherry Studio 的任意一个问答窗口,点击知识库按钮,关联刚才创建好的知识库

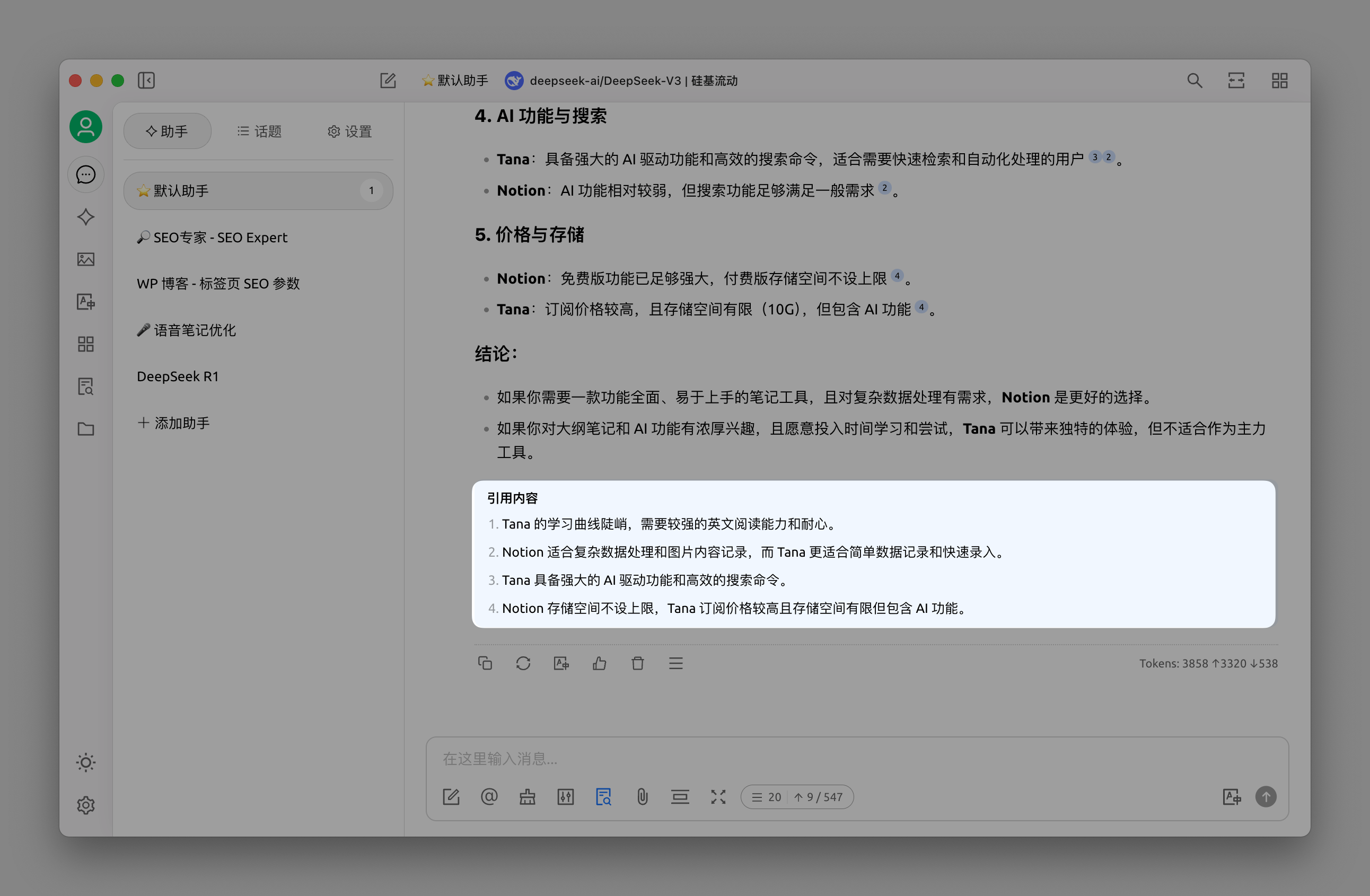

然后就可以对这个知识库进行提问了,并且回答也会显示引用来源

知识库建好之后,下一步做什么?

RAG 真正有价值的地方,不只是“你问我答”,而是把零散资料慢慢沉淀成可复用的工作方式。知识库一旦建好,后面更关键的是怎么把回答继续接到你的笔记、任务和项目里。

如果你也在用 Notion,可以继续看这篇更偏实战的文章:Notion Agent 完整教程:怎么把 AI 真正接进工作流。

如果你更想直接看一套现成工作台,也可以看看我长期在用的 FLO.W 思流。它更适合承接资料沉淀、任务推进和项目协同。

关联阅读

- 免费 DeepSeek R1 薅羊毛教程|白嫖 5000 万 Token|欧派云、火山引擎配置教程

- DeepSeek R1 薅羊毛教程|2000 万 Tokens 额度,免费使用国产最强 AI 大模型 API

- Obsidian 剪藏插件教程,用 DeepSeek 配置 AI 自动总结

- 在 Obsidian 中集成 AI 问答功能:Obsidian Copilot + DeepSeek 设置教程

关联视频

如果你想用 DeepSeek 和本地知识库辅助 Notion 的内容管理,推荐看看 FLO.W——一套帮你整合生活与工作的 Notion 系统。 了解 FLO.W →

本站所有文章,除非特别说明或标注,均为本站原创发布。转载本文需附上本文链接,未经授权,禁止大篇幅复制、盗用、采集或发布本站内容至其他网站、书籍等各类媒体平台。